Policja z Kalifornii reagująca na alarmy generowane przez oparty o sztuczną inteligencję system ShotSpotter znajduje dowody rzeczywistego przestępstwa związanego z bronią tylko w jednym przypadku na dziesięć – tak przynajmniej wynika z badań chicagowskiego Watchdoga.

Jak to (nie) działa?

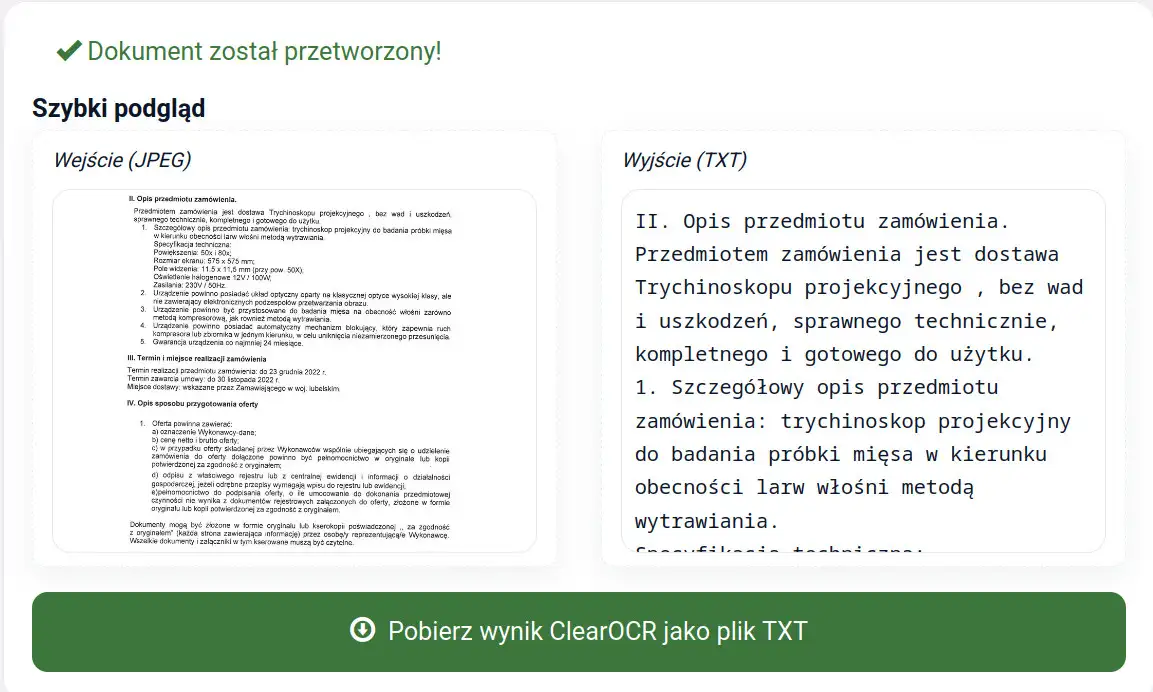

Kalifornijska firma wykorzystuje algorytmy uczenia maszynowego, aby określić czy głośne dźwięki (uderzenia, huk) wychwycone przez mikrofony rozmieszczone w ponad 100 miastach Stanów Zjednoczonych są wystrzałami czy nie. Jeśli strzał zostanie zidentyfikowany, jego lokalizacja jest triangulowana i natychmiast wysyłana na policję w formie alarmu a raporty są później przetwarzane na potrzeby prokuratorów (do wykorzystania w sprawach sądowych).

ShotSpotter jest teraz pod ostrzałem krytyki ponieważ 65-letni mężczyzna spędził prawie rok za kratkami oczekując na proces o morderstwo - a głównym dowodem przeciwko niemu był kwestionowany raport ShotSpottera o wystrzale.

Fajerwerk zamiast wystrzału

Michael Williams został w zeszłym roku oskarżony o zastrzelenie i zabicie 25-letniej Safarian Herring i zaprzeczył wszelkim zarzutom. Prokuratorzy stwierdzili, że ShotSpotter odebrał dźwięk wystrzału dokładnie w miejscu i czasie, kiedy Williams był widziany w swoim samochodzie w Chicago gdy podwoził Herring. Williams bronił się podnosząc, że Herring została trafiona nabojem, który wystrzelono z przejeżdżającego samochodu.

Co istotne, prawnicy Williamsa poprosili sędziego o zbadanie dowodów z ShotSpottera po tym, jak okazało się, że oprogramowanie AI faktycznie wychwyciło fajerwerk oddalony o milę, a informacja ta została później zweryfikowana przez pracowników ShotSpottera. W odpowiedzi prokuratura wycofała raport ShotSpottera, a w zeszłym miesiącu poprosiła o oddalenie sprawy, ponieważ nie miała już wystarczających dowodów na poparcie oskarżenia. Sędzia zgodził się, a Williams został zwolniony z aresztu.

Miliony dolarów, dziesiątki tysięcy alarmów

Tzw. Biuro Inspektora Generalnego miasta Chicago postanowiło bliżej przyjrzeć się alarmom, jakie ShotSpotter wysyła akurat do chicagowskiej policji i miejskiego Biura Zarządzania Kryzysowego. Miasto podpisało z firmą ShotSpotter trzyletni kontrakt o wartości 33 mln dolarów, który miał wygasnąć w sierpniu 2021 roku, ale w grudniu ubiegłego roku został przedłużony do połowy 2023 roku.

Organizacja stwierdziła, że 50176 alarmów wygenerowanych przez ShotSpotter w Chicago pomiędzy styczniem 2020 roku a majem tego roku miało wskazywać na zaistnienie strzelaniny a na wskazywanych miejscach pojawiali się funkcjonariusze. Spośród tych alarmów 41830 zakończyło się jakąś akcją policji, znaną ogólnie jako „zadysponowanie”. Ale z tych „dyspozycji” tylko 4556 kończyło się znalezieniem dowodów na popełnienie przestępstwa związanego z bronią.

Tak więc, tylko 9,1 procent alarmów ShotSpottera doprowadziło do znalezienia przez policję dowodów rzeczywistego przestępstwa z użyciem broni.

Watchdog stwierdza w swoim raporcie, że technologia może prowadzić do nadmiernego wysyłania funkcjonariuszy w poszukiwaniu poważnych przestępstw, które nigdy nie miały miejsca. Oprogramowanie i sprzęt ShotSpottera są zastrzeżone i nie były nigdy otwarcie audytowane a sama firma twierdzi, że algorytmy stworzone przez jej programistów są w 97 procentach dokładne.

Policja broni ShotSpottera

Zdaniem rzecznika chicagowskiej Policji:

Aby ograniczyć przemoc z użyciem broni, wiedza o tym, gdzie do niej dochodzi, jest kluczowa. ShotSpotter wykrył setki strzelanin, które w innym przypadku nie zostałyby zgłoszone i jest jednym z wielu narzędzi używanych przez policję chicagowską w celu zapewnienia bezpieczeństwa publicznego i ratowania życia. Używając ShotSpottera policja otrzymuje w czasie rzeczywistym alerty o wykrytych strzelaninach, umożliwiając patrolującym funkcjonariuszom szybkie dotarcie do dokładnego miejsca zdarzenia. Zamiast polegać na historycznie niskim wskaźniku połączeń z numerem 911, organy ścigania mogą reagować szybciej, aby zlokalizować i pomóc ofiarom, zidentyfikować świadków i zebrać dowody kryminalistyczne. System pomaga też w sytuacji gdy mieszkańcy chcą pozostać anonimowi.

Przypomnijmy, że to nie jedyny problematyczny wkład technologii w amerykański wymiar sprawiedliwości.