Praktycznie wszystkie serwisy i aplikacje zbierające dane o użytkownikach zapewniają ich o anonimowości. Przez anonimowość rozumie się tutaj to, że na podstawie zagregowanych danych niemożliwe jest jednoznaczne zidentyfikowanie użytkownika. Jakiego jednak rodzaju jest ta niemożliwość? Prace brytyjskich i belgijskich informatyków pokazują, że w najlepszym razie jest to niemożliwość prawna. Opracowali oni algorytm, który jest w stanie zidentyfikować 99,98% użytkowników z niemal każdego zbioru „zanonimizowanych” danych.

W większości krajów świata zanonimizowane dane nie są uznawane za dane osobowe. Pozwala to na ich udostępnianie i sprzedawanie bez naruszania regulacji takich jak RODO. Firmy zajmujące się marketingiem internetowym płacą chętnie za wszelkiego rodzaju takie dane, opisujące zwyczaje zakupowe konsumentów, upodobania randkowe czy wybór filmów w serwisach streamingowych.

Jednak nawet zanonimizowane zbiory danych często zawierają zestawy tzw. atrybutów – charakterystyki dotyczące osoby fizycznej lub gospodarstwa domowego. Szacuje się, że w dostępnych na rynku zbiorach danych znaleźć można nawet 248 takich charakterystyk na jedno gospodarstwo domowe. Bez obaw jednak, wszyscy zapewniają, że są one „zanonimizowane”, a więc nawet gdyby wyciekły, nikomu nie grozi ujawnienie ich danych osobowych.

A jednak zapewnienia prawników są niczym wobec wad natury matematycznej, jakie obnażono w procesie anonimizacji. Naukowcy z Imperial College London i Université Catholique de Louvain w Belgii przedstawili na łamach periodyku Nature Communications algorytm, który może zidentyfikować 99,98 procent Amerykanów na podstawie prawie każdego dostępnego zestawu danych z zaledwie 15 atrybutami, takimi jak płeć, kod ZIP lub stan cywilny.

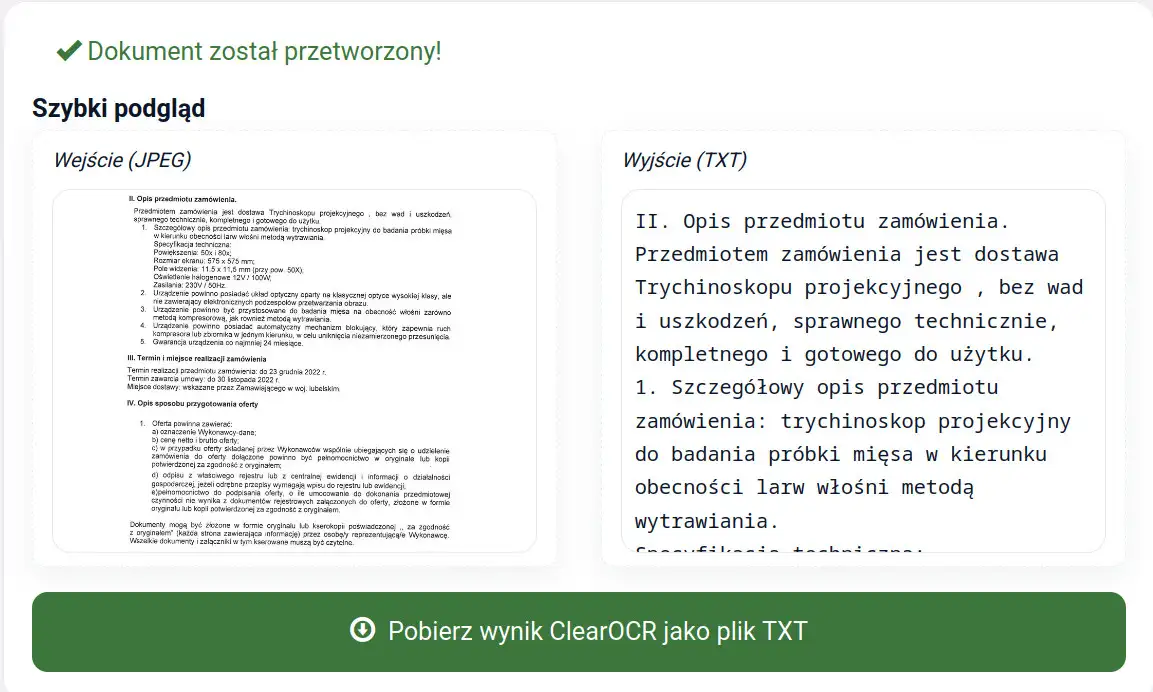

Co więcej, badacze opublikowali online gotowe narzędzie do deanonimizacji zbiorów danych – tak by każdy mógł z niego skorzystać. Yves-Alexandre de Montjoye, informatyk z Imperial College London i główny autor opublikowanej w Nature Communications pracy przyznał, że to była trudna decyzja, jednak po prostu nie było innej możliwości.

Po całym świecie krążą góry anonimowych danych, które są zagrożone. Badacze mieli wybór: albo siedzieć cicho i udawać, że nic się nie stało, albo opublikować odkrytą metodę, tak, aby dostawcy danych mogli zabezpieczyć przyszłe zestawy danych i zapobiec ponownej identyfikacji osób, zanim zrobią to cyberprzestępcy.

Już dzisiaj mówimy więcej niż byśmy chcieli

Czemu przyszłe? Bo z obecnie istniejącymi to już się przecież dzieje. W 2016 roku zidentyfikowano polityków w anonimowym zestawie danych historycznych 3 milionów obywateli Niemiec, ujawniając ich informacje medyczne i preferencje seksualne. Kilka miesięcy wcześniej australijski Departament Zdrowia opublikował publicznie niezidentyfikowane dane medyczne dla 10% populacji tylko po to, aby zostały one zidentyfikowane 6 tygodni później – wystarczyły podstawowe atrybuty demograficzne oraz fakt, że kody diagnostyczne, rok urodzenia, płeć i pochodzenie etniczne mogły jednoznacznie identyfikować pacjentów.

Tak samo też udało się jednoznacznie zidentyfikować osoby na podstawie zanonimizowanych danych o przejazdach taksówek w Nowym Jorku, podróżach rowerowych w Londynie, ruchu pasażerów metra w Rydze oraz użycia telefonów komórkowych i kart kredytowych.

Oczywiście firmy kwestionują zazwyczaj ważność tej re-identyfikacji użytkowników czy pacjentów. ponieważ zestawy danych były niekompletne, badacze nie mogą być pewni, że ponownie zidentyfikowali właściwą osobę, nawet jeśli znaleźli dopasowanie. Zapewniać to miałoby wiarygodną zaprzeczalność dla takiej próby identyfikacji. Zbiory danych „zanonimizowanych” są bowiem najczęściej niekompletne, np. dlatego, że zostały poddane podpróbkowaniu w ramach procesu deidentyfikacji.

Prawo musi dorównać nauce

Osiągnięcie brytyjskich i belgijskich informatyków polega na zaproponowaniu i wykazaniu poprawności modelu statystycznego, który pozwala na udane próby reidentyfikacji, nawet jeśli ujawniony zbiór danych jest w dużym stopniu niekompletny. Już niewiele atrybutów jest wystarczających do ponownej identyfikacji osób z dużym zaufaniem w mocno niekompletnych zbiorach danych. Pobieranie próbek lub udostępnianie częściowych zbiorów danych, np. z jednej sieci szpitala lub jednej usługi online, nie zapewnia żadnej wiarygodnej zaprzeczalności.

Poza zaprzeczeniem twierdzeniu, że niekompletność zbioru danych zapewnia wiarygodną zaprzeczalność, badaczom udało się zakwestionować również twierdzenie, że niska wyjątkowość populacji jest wystarczająca, aby chronić prywatność ludzi.

Oznacza to, że konieczne jest zredefiniowanie na poziomie prawnym obecnych regulacji anonimizacji danych. Muszą one uwzględniać indywidualne ryzyko ponownej identyfikacji i braku wiarygodnej zaprzeczalności nawet dla niekompletnych zbiorów danych. Konieczne jest też rozpoznanie istnienia systemów zwiększających prywatność i środków bezpieczeństwa, które pozwoliłyby na wykorzystanie danych przy jednoczesnej skutecznej ochronie prywatności ludzi.

Póki co kod źródłowy pozwalający odtworzyć eksperymenty został opublikowany na stronie Computational Privacy Group, wraz z dokumentacją i przykładami.