Podczas tegorocznej edycji Pwn2Own po raz pierwszy konkurowano w nowej kategorii: śmiałkowie mieli złamać zabezpieczenia w oprogramowaniu zainstalowanym na Tesli 3. Udało się to, niemniej spenetrowano wyłącznie system infotainment. Strategiczne moduły, jak np. autopilot, pozostały bezpieczne.

Nie oznacza to jednak, że pasażerowie autonomicznych samochodów mogą czuć się bezpiecznie. Mamy już bowiem solidne potwierdzenie, że możliwe jest narażenie ich na śmiertelne niebezpieczeństwo bez konieczności żmudnego włamywania się do Tesli i przejmowania nad nią kontroli. Okazuje się, że równie niebezpieczne mogą być próby oszukiwania autopilota.

Zobacz też: Tesla Model 3 zhakowana podzas Pwn2Own. Zawiniła luka w Chromium

Dan Goddin z redakcji Ars Technica informuje o udanym eksperymencie przeprowadzonym w Tencent Keen Security Lab z użyciem Tesli Model S. Jak wiadomo, oprogramowanie w samochodach Tesla umożliwia już dziś w zasadzie całkowitą automatyzację prowadzenia pojazdu. Samochód zbiera dane o otoczeniu za pomocą kamer, radarów i emisji ultradźwięków i tym sposobem rozpoznaje punkty odniesienia, np. pasy jezdni, znaki i przeszkody.

Schemat z naniesionymi czujnikami pokazuje jak Tesla „widzi” otoczenie.

Schemat z naniesionymi czujnikami pokazuje jak Tesla „widzi” otoczenie. Badacze z Tencent Keen Security w swojej pracy opisują metodę na oszukanie tych czujników. Co ważne, nie wymaga ona nakładu dużych środków i jest relatywnie dyskretna. Z pomocą inżynierii wstecznej odnaleźli oni sposób na oszukiwanie czujników analizujących lokalizację prawej zewnętrznej linii ciągłej. Wystarczyło nakleić na jezdnię trzy kropki, by Tesla S zjechała na przeciwny pas i docelowo doprowadziła do zderzenia czołowego z samochodem nadjeżdżającym z przeciwka.

Zobacz też: FreedomEV – czy w przyszłości będziemy rootować samochody jak smartfony?

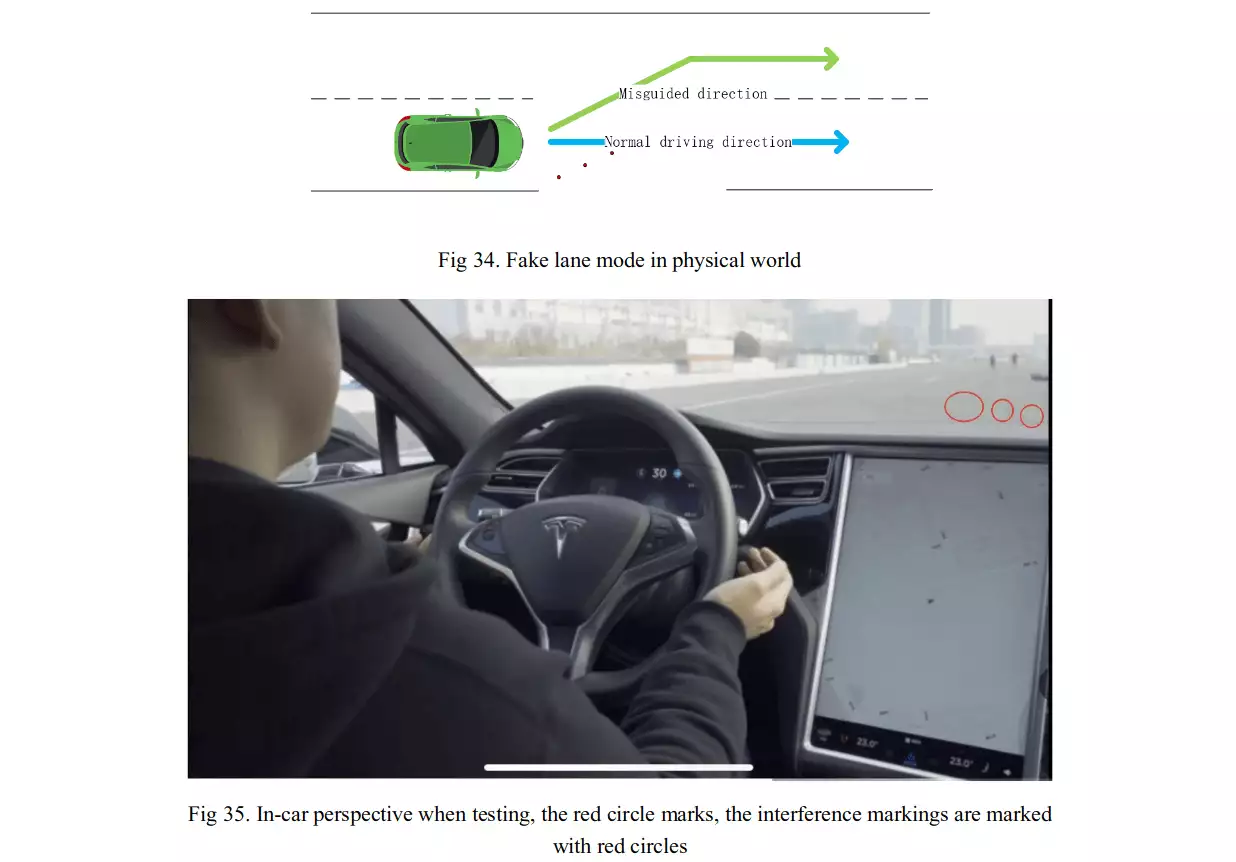

W rozpoznawaniu pasów jezdni oprogramowanie Tesli stosuje wyłącznie kamery – to za ich pomocą rysowana jest wirtualna siatka. Na nią z kolei nakładane są wektory odpowiadające liniom na jezdni. Niestety, wystarczy nakleić na jezdni trzy niewielkie kropki, by komputer pokładowy skierował pojazd na lewy pas. Trudno o podatność bardziej pomocną podczas prób pozorowania wypadku samochodowego.

Schemat ataku „false lane”

Schemat ataku „false lane” Według rzecznika Tesli, warunki, w których przeprowadzano eksperyment, nie są możliwe do otworzenia na prawdziwej drodze. Poruszanie się Teslą wymagać ma bowiem czujności kierowcy, a ten w analizowanym scenariuszu będzie miał wystarczająco wiele czasu, by zapobiec katastrofie. Jak jednak wiemy, niemal wszystkie dotychczasowe wypadki z udziałem autopilota wynikały z tego, że kierowca nie śledził wydarzeń na drodze, a w niektórych wypadakch... spał.